Arbeitsweise der KI auf dem UGREEN iDX6011 NAS, was die kann und wie sie arbeitet

Hinsichtlich der 64 GB RAM der Pro bin ich noch etwas skeptisch.

Ich habe auf meiner Minisforum N5 pro die Synology AI Console eingerichtet und als Datenbasis dafür die Docker-Container Ollama und Open WebUI laufen und Open WebUI mit der AI Console verknüpft. Das ist im Grunde so ähnlich, wie Ugreens Uliya. Mit Ollama läuft das soweit ganz gut und man kann innerhalb der Synology Groupware diverse Inhalte abrufen oder erstellen lassen, z.B. in Mailplus ein Anschreiben, Formelvorschläge im Tabellentool "Excel", Textvorlagen im Schreibtool "Word" wie in Mailplus usw.

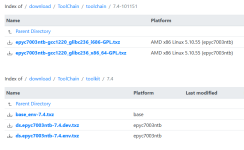

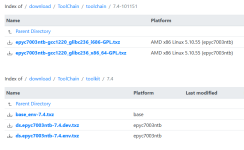

Dockercontainer und Datenbasis sollte aber besser auf SSD / NVMe laufen. Soweit, so gut, spannend wird es nun aber mit der eigentlichen Datenbasis und verfügbarer RAM. Ich habe von Ollama zwei Pakete getestet, llama 3.2 mit ca. 2 GB Grösse und llama 4 mit 67 GB Grösse und es ist wohl überflüssig zu sagen, welches das rundere und ausführlichere Ergebnis liefert. Schon mal klar ist, wenn v3.2 aktiv nach Ergebnissen sucht, geht das schneller und braucht rund 6-10 GB RAM, ist nun v4 unterwegs, werden rund 65-70 GB RAM belegt.

Meiner Ansicht nach, kann es sich mit der von Ugreen eingesetzten Lösung um keine ausführliche Lösung handeln und ob die Datenbasis auf der iDX vollumfänglich vorgehalten wird, ist schon wegen des RAM fraglich. Anders ist nicht erklärbar, weshalb "nur" 32 GB bzw. 64 GB in den iDX und auch noch fest installiert sind, weil die Grösse des RAMs auch die Grösse und damit den Wissensumfang eines KI-Modells beschränkt. Es gibt von llama 4 auch KI-Pakete, die gestuft eine Grösse mit über 800 GB erreichen, dann fallen auch einige 100 GB RAM an, insofern kann es also sowas nicht sein.

Wir werden sehen, ich habe ja eine iDX6011 pro erworben. Gespannt darf man sein auf die kommende Minisforum N5 Max, die da ordentlich nochmals was draufsetzt, aber auch einen festverlöteten RAM hat, 128 GB LPDDR5x.